2013 年 6 月,前美国国家安全局承包商雇员爱德华·斯诺登在香港的一家酒店里,向《卫报》和《华盛顿邮报》的记者展示了一批绝密文件。随后数年,围绕监控、隐私和数字权力的争论席卷全球。但在这场风暴的底层,藏着一个被大多数人忽略的物理事实,一个纯粹的技术参数——存储容量。

据斯诺登披露的文件,NSA 犹他数据中心的存储容量估计在 3 到 12 艾字节之间。注意这个词:艾字节。(注:NSA 从未正式公布设计容量。媒体报道的估算范围从若干 EB 到 YB 级别均有,Forbes 基于泄露蓝图的工程推算约为 3-12 EB;此处取主流保守估算。)

这是绝大多数人第一次在新闻标题里看见它。在此之前,“艾字节”最多出现在某些计算机科学论文的脚注里。在此之后,它变成了一个隐喻——一种足以吞下整个互联网记忆的巨兽的量词。

Exabyte,中文 艾字节,或者你不太可能在任何消费产品包装盒上见过的写法——1 EB。

1 EB = 1024 PB = 1,048,576 TB = 1,152,921,504,606,846,976 字节。大约 115 亿亿字节,或者说一百一十五万太字节。这个数字已经大到人类大脑无法凭直觉去感受了,需要动用比喻和数学来把它拆开。

但在所有关于 EB 的拆解开始之前,有一个问题更值得我们停下来想一想:当人类第一次需要用一个叫“艾字节”的词去描述存储时,这条文明的小船,已经悄悄划过了一道什么样的分水岭?

一、Exa- 这个词:从希腊到硅谷

在希腊语里,hexa 是“六”的意思——但 hexa 已经被占据为“十六进制”的词根了,没法再用。于是更生僻的希腊词 hexakosioi(意为“六百”)被拿出来,从中抽出 ex- 这个前缀,强行赋予了它 10^18 的含义。1975 年,国际计量大会(CGPM)正式批准 exa- 作为国际单位制前缀,表示 10^18。注意,这是十进制版本的——它甚至不是为计算机而生的。

计算机世界接过这个前缀之后,按照自己一贯的“1024 才是 1000”的逻辑,把 1 EB 定义为 2^60 字节,即 1,152,921,504,606,846,976 字节——比十进制的 1 EB 多了大约 15%。没错,又是那个我们早在 KB 篇就讲过的度量衡老账,到了 EB 这个量级,这笔糊涂账的绝对差额大到离谱:十进制和二进制之间的 EB 差了大约 1.5 亿 GB。一亿五千万个 GB,足够把 Windows 95 安装 300 万次所差的容量,在计算口径的一念之间就出现了。

Exa- 这个词根真正嵌入计算机行业的日常词汇表,始于 1990 年代末到 2000 年代初。彼时互联网正在经历第一次爆炸式增长,超级计算机的吞吐能力爬到了 TB 级,而思科(Cisco)这样的网络设备厂商开始大量发布关于“全球 IP 流量”的预测白皮书。这些白皮书里出现了一个在当时看起来近乎科幻的预测:到某个时间节点,全球互联网的年数据流量将突破 1 EB。

1 EB 的数据流量。不是存储,是流动——一年之内,全人类在互联网上产生和消耗的数据总量,跨过了这条线。思科在 2008 年前后的《视觉网络指数》(VNI)报告中,正式宣告了这一预测。事实上,据该系列报告的数据追溯,全球 IP 流量在 2001 年突破 1 EB/年大关,到 2007 年左右月均流量突破了 1 EB。(注:思科 VNI 白皮书在 2000 年代末首次广泛进入大众视野,而其数据回溯将 1 EB 年流量的临界点锚定在 2001 年前后)

这意味着什么?意味着在乔布斯掏出第一代 iPod 的同一年——在他把“一千首歌装进你的口袋”的同一年——整个互联网一年的数据流量,已经跨过了 1 EB。GB 和 EB 在同一个历史时刻共存于世界的两端:这是信息尺度最迷人的折叠瞬间。

二、互联网的脊椎:1 EB 的流动比 1 EB 的静止更早到来

在 PB 篇里我们说过,存储从 PB 开始变成了一种像呼吸一样的公用设施。但 EB 时代带来的是一个更深层的变化:在 PB 时代,你先存数据,再考虑怎么用它。在 EB 时代,数据还没存稳,就已经被用掉了。 流动比静止更重要。

我们来看几个可见的证据。

谷歌的爬虫与索引。 谷歌在 2008 年的一篇官方博文中透露,其系统检测到的独立 URL 数量已突破 1 万亿。即使每个页面的平均索引大小只有几十 KB,整个网页索引的规模也已经稳稳进入了 EB 俱乐部的门槛。而这个索引不是“存着不动”的——它需要持续更新、重组、压缩、分发到全球各地的边缘节点。每一次你搜索“天气”,命中的不只是某一个机房里的一块硬盘,而是分布在全球几十个数据中心里、不断被重新计算和排序的一整套 EB 级索引碎片。

Netflix 的视频编码矩阵。 2007 年,Netflix 从 DVD 邮寄业务转型为流媒体服务。到 2010 年代,Netflix 的全球订阅用户突破 1 亿,每人每天观看数小时的高清视频。为了适应从 50 英寸电视到 5 英寸手机屏幕的所有观看场景,Netflix 会对同一部影片生成数百个不同分辨率、码率、编码格式的版本,并将它们分发到全球上千个 CDN 节点。整条管道里的总副本量,是一个 EB 级的数字。你按下的每一次播放键,背后都是几个 EB 的数据在为你冲刷出一个最流畅的观影体验。

科学计算的“一次实验,一辈子看不完”。 我们之前提到了 CERN 的 LHC——大型强子对撞机每年产生超过 30 PB 的原始碰撞数据。但这只是冰山一角。LHC 的四个大型探测器(ATLAS、CMS、ALICE、LHCb)在实验阶段的总数据产出量,加上模拟重建数据、分析派生数据,整个生命周期累计的数据规模早已迈过 1 EB 的门槛,具体数字取决于你如何划分原始数据与派生数据的边界。2012 年发现希格斯玻色子的那个信号,就藏在数十 PB 的背景噪声里。1 EB 是物理学家们淘金的那条数据之河——而金子只有其中一撮。

社交网络的“沉默的大多数”。 你在 Instagram 上发一张照片,它会被自动转码成多种分辨率,复制到多个地理区域的服务器上,塞进自动内容审核的队列里,生成多种视觉特征的索引,最后才出现在你朋友的 feed 流里。你只发了一次,但后台大概存了 6 到 8 份。当全球每天上传数十亿张图片和视频时,整个 Instagram 的存储架构管理着一个 EB 级的持续膨胀的数据池——而你只看得见其中你自己的那个小小剖面。

三、TSMC 与 ASML:EB 时代的看门人

讲到这里,我们还没正面回答一个问题:用什么硬件来承载 EB?

在 PB 篇,我们还能津津乐道地比较 IBM 3380 的 250 公斤和 M.2 SSD 的口香糖大小。在 TB 篇,我们还能说“一块 20 TB 的硬盘塞进 1U 服务器,五台机器拼出一个 PB”。但到了 EB 这个量级,单纯的“硬盘数量”不再有意义。真正决定一个 EB 能否被经济地存储和访问的,是 半导体工艺的制程节点 和 光刻技术的极限精度。

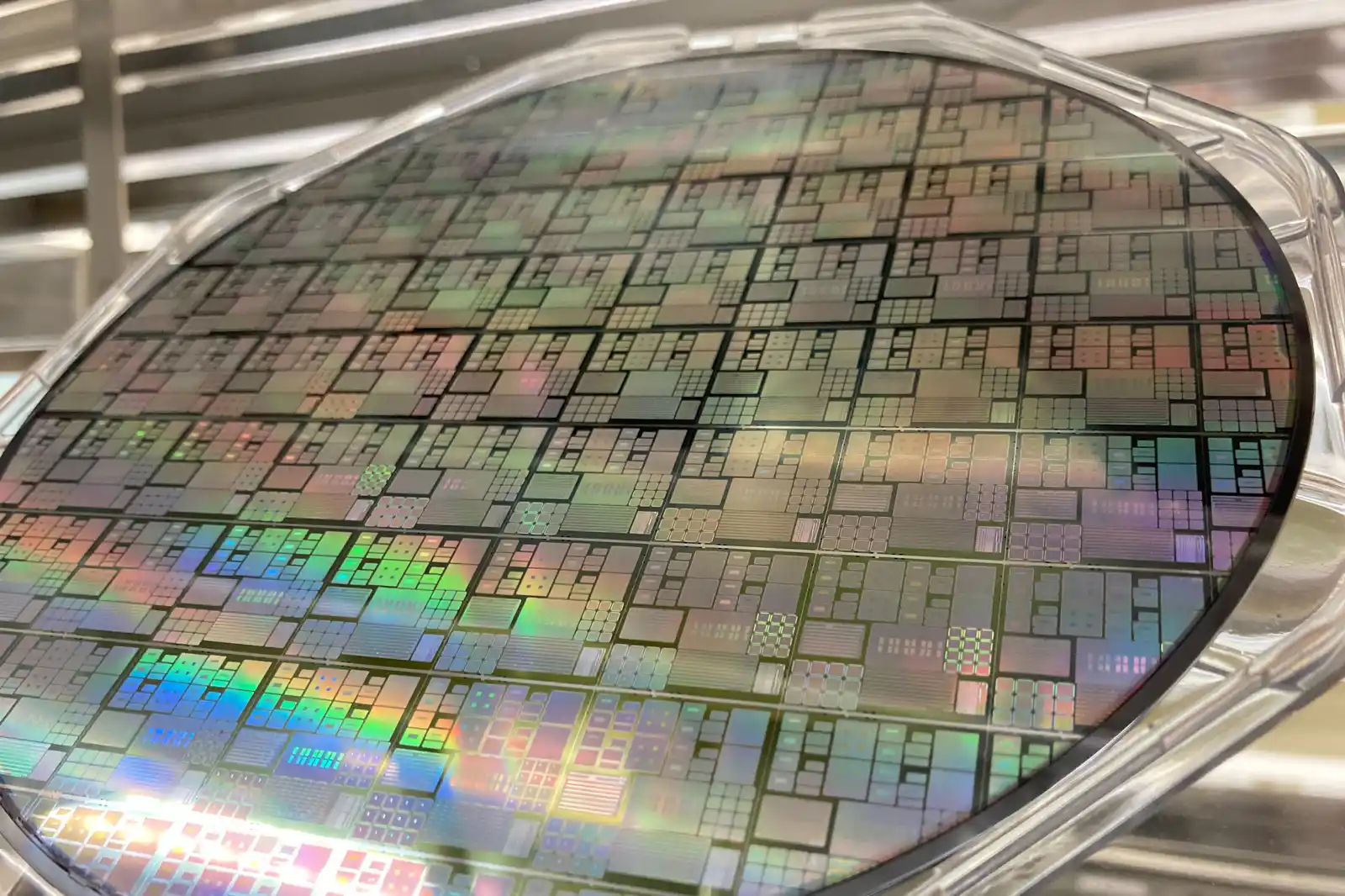

这就是 EB 时代最容易被忽略、却最根本的硬约束:你的全部数据,不论存在哪个云厂商的哪个数据中心里,最终都刻在一张张晶圆上。而晶圆,是用光刻机一根一根线地“画”出来的。

TSMC(台积电) 是目前全球最先进的芯片代工厂。它生产的高密度 NAND 闪存控制器、服务器 CPU 和 AI 加速器,是每一座 EB 级数据中心的物理底座。而 TSMC 的产线里站着 ASML——荷兰一家近乎垄断极紫外(EUV)光刻技术的公司,一台 EUV 光刻机售价超过 1.5 亿美元,需要 40 个集装箱才能运输,安装调试耗时数月。每一片先进制程的晶圆,都必须经过 ASML 的光刻机。

这意味着一个看似遥远、实则极其直接的因果链:ASML 产出的光刻机数量,约束着 TSMC 的先进制程产能;TSMC 的产能量,约束着全球高密度 3D NAND 闪存和服务器芯片的出货量;而这些芯片的出货量,又约束着云厂商能以多快的速度、多低的成本扩张 EB 级存储阵列。2023 年到 2024 年间全球围绕 AI 算力爆发的产能争夺,其实就是这条因果链在真实商业世界的一次公开发作。

EB 的存亡,不是被硬盘决定的,而是被光刻机决定。这是信息尺度膨胀到一定数量级之后,物质世界反过来施加的最冷酷的物理制约。

四、比特衰变在 EB 尺度上的终极形态:存档艺术的危机

在 PB 篇我们聊过“比特衰变”——存储介质里的电荷缓慢泄漏,磁畴取向逐渐漂移,导致数据在无人察觉的情况下静默损坏。在 PB 尺度上,这是一个概率问题。在 EB 尺度上,它是一个不容商量的物理定律。

一个 EB 系统中大约有 2^60 个比特。即便每个比特每年出现错误的概率低到 10^-18,一个 EB 的系统每年也会发生大约一次不可检测的比特翻转。而实际的错误率远远高于这个数字——普通消费级内存的软错误率在 10^-12 到 10^-15 每比特每小时的数量级,企业级硬件虽然低几个数量级,但在 EB 尺度下依然杯水车薪。

这就是为什么所有 EB 级系统都必须采用端到端的数据完整性校验——从磁盘扇区的 ECC,到文件系统的校验和,到网络传输的 CRC,到应用层的副本比对。每一层都在和比特衰变搏斗。你的数据能在云盘里安然无恙地躺十年,不是因为硬盘不会坏,而是因为有一整套算法体系在持续不断地自查、修复和迁移副本。存储,在 EB 尺度上,不再是一个硬件问题,而是一个数学问题。

但比比特衰变更隐蔽的威胁是 人类知识格式的断代。你在 1990 年代用 WordPerfect 写的文档,今天大概率已经打不开了。你在 2000 年代刻录的 CD-R,镀层可能已经开始氧化剥落。一个 EB 的存储系统每时每刻都在刷新自己的硬件——硬盘换成 SSD 再换成下一代持久内存,接口从 SATA 变成 SAS 变成 NVMe 变成未来的 CXL。每一次硬件代际更迭,都意味着数据必须被迁移。而这个迁移过程本身,就是一次大规模复制,带着引入新错误的可能性。

云厂商解决这个问题的方式是“永远在迁移”——数据从老旧硬件向新硬件持续流动,从不给任何一个平台安静老去的时间窗口。这听起来像是永生的技术承诺,但它也带来一个令人不安的哲学问题:如果一个数据被持续重建了五十年,经历了三代文件系统和两种编码标准的变迁,它还是原来那个数据吗?你还能肯定地说,这份从祖父硬盘里抢救出来的数码档案,和五十年前存档人保存进去的那一张唯一的底本是同一个文件吗?

这不是杞人忧天。CERN 在管理 LHC 数据时就遇到了这个问题:早期的实验数据存进了某种磁带格式,十几年后,能读取这种格式的驱动器和软件环境已经不存在了。他们需要专门维护一套“格式遗产系统”,用来持续把旧数据转换成新格式——永无止境。

五、1 EB 能装什么

让我们来做最后一次换算。以下换算主要采用二进制前缀(1 EB = 1024 PB),但由于 EB 实在太大,微小误差不影响直觉感受:

- 约 2.5 亿部高清电影(每部 4 GB)——假设你从公元前 3000 年埃及第一王朝建立开始每天看一部电影,到今天还没看完一个零头。

- 约 3000 亿首 MP3 歌曲——地球总人口 80 亿,每人分 37 首,还剩一大堆。

- 整个人类有史以来说过的所有话——据语言学家估算,所有人类在所有时代说出的话语,如果全部转换成纯文本,大约在 1 到 5 EB 之间。也就是说,1 EB 大约等于全人类历史上所有口头语言的文字记录的五分之一到等身。这个数字小得让人吃惊——我们说了几十万年的话,总量不过几个 EB。而今天全球互联网一年的 IP 流量已经超过 5000 EB。

- 整个人类有史以来说过的所有话——按语言学文献中的中位估算,每人每天约说 16,000 词,平均词长 5 字符,70 年寿命,一生约产生 2 GB 纯文本原始数据。以历史总人口约 1,000 亿人(绝大多数未活到成年)、去重压缩 10 倍计,所有人类在所有时代说出的话语,全部转换成纯文本存储,粗略估计为 50 EB。这个数字小得让人吃惊——我们说了几十万年的活话,总量不过几十个 EB。而今天全球互联网一年的 IP 流量已经超过 5,000 EB。

- 谷歌在 2010 年代中后期管理的索引与网页库规模——虽然谷歌从不公布精确数字,但多方分析师估算其原始网页库与索引的总和早已进入 EB 俱乐部,且正在向更高量级迈进。

- 全人类基因组数据的总量——假设为 80 亿人做全基因组测序,每人原始数据约 150 GB(haploid),总数据量约为 1200 EB。1 EB 大概能装下全球千分之一人口的全基因组数据。

而承载这些数据的物理载体——在 2026 年的今天,一块 30 TB 的企业级硬盘重量约为 690 克。要达到 1 EB 的原始容量,大约需要 36,000 块这样的硬盘,总重量约 25 吨。加上服务器机箱、电源、网络设备和制冷系统,一整套 1 EB 存储集群大概需要一个中等规模的数据中心大厅来容纳,耗电量足够一个万人小镇的所有生活用电。

六、1 EB 的公共面孔:你已经是它的原住民

和 PB 一样,EB 也没有完全把自己关在数据中心里。它有几个你在日常生活中反复接触、却从没和“艾字节”这个拗口词联系起来的公共面孔。

短视频平台。 TikTok 和抖音的全球日活用户超过 15 亿,每天产生的视频数据量在 PB 级,月度数据量轻松突破 EB。你在地铁上划过的每一个 15 秒视频,都经过编码、分发、缓存、推荐算法的无数次读写——整个系统围绕一个 EB 级的动态内容池在运转。你每天刷 2 小时,就是在 2 小时的物理时间里,以大约 10 到 30 Mbps 的速度穿过自己那根细管,贪婪地在这个 EB 大池里切下属于你一个人的一道薄片。

大语言模型。 GPT-4 和类似规模的大模型在训练阶段需要处理数十 TB 到 PB 级的高质量文本语料,而整个互联网级原始语料的总规模——包括 Common Crawl 的全部网页爬取结果——在 2020 年代已达数十 PB 级别,单次月爬取约 344-363 TiB。这些语料在被清洗、去重、分词之前,以原始形态存储在 PB 甚至 EB 级的分布式文件系统上。你每次和 ChatGPT 聊天,背后是一套从 EB 级语料库中被蒸馏出来的权重,在你打出每一个字的时候沉默地运算。

自动驾驶。 一辆 L4 级自动驾驶测试车每天产生的传感器数据——激光雷达、摄像头、毫米波雷达、高精度 GPS——在 4 到 20 TB 之间。以 Waymo 测试车为例,每小时产生约 1,100 GB 数据,按一天运行 24 小时计算约 26 TB。一个拥有 100 辆测试车的车队,每月产生的数据量超过 30 PB。而自动驾驶公司需要将这些数据全部回传、标注、清洗并用于模型训练。行业头部玩家的累计数据量已经摸到了 EB 的门槛。硅谷的路口和北京的高架桥,正在以艾字节的精度被数字化重造。

七、EB 的告别:始于犹他,不止于犹他

让我们回到 2013 年的香港,回到斯诺登和记者们待过的那间酒店房间。

为什么是犹他州?为什么 NSA 要在一片沙漠里建造一个艾字节级别的数据中心?官方的解释是:为了支撑情报分析。但更深层的逻辑,EB 这个单位自己的物理属性,已经替他们回答过了。

EB 需要荒凉。EB 需要廉价的电力、稳定的地质、远离飓风和地震带的土地。EB 不能生活在人类旁边——它太热、太吵、太耗电。于是它被发配到沙漠、北极圈、海底和废弃的矿山里。在 PB 时代,数据中心还像一座仓库。在 EB 时代,数据中心更像是这个文明偷偷埋在地下的维生装置——它不体面,不显眼,但断了电整个数字世界就会窒息。

如果整个信息尺度是一个正在不断扩张的文明——从 1 bit 的烽火台到 1 PB 的都市,那么 1 EB 就是这个文明建造的第一座“大陆级工程”。它不再是某个公司或某个国家的财产,它是人类这个物种作为整体产出的信息废气的总汇集。

而从 1 EB 再跨出下一步,就不再是“更大”,而是“另一种东西”。在那里,1 EB 只不过是一块即将被吞没的垫脚石。人类给这个下一级取了一个名字,它本身就是一整个海洋。

下一个单位:1 ZB。在那个尺度上,我们不再谈论地球上的数据,而是开始谈论全人类作为一个文明所拥有的全部数字储备。欢迎来到信息世界的半球尺度。